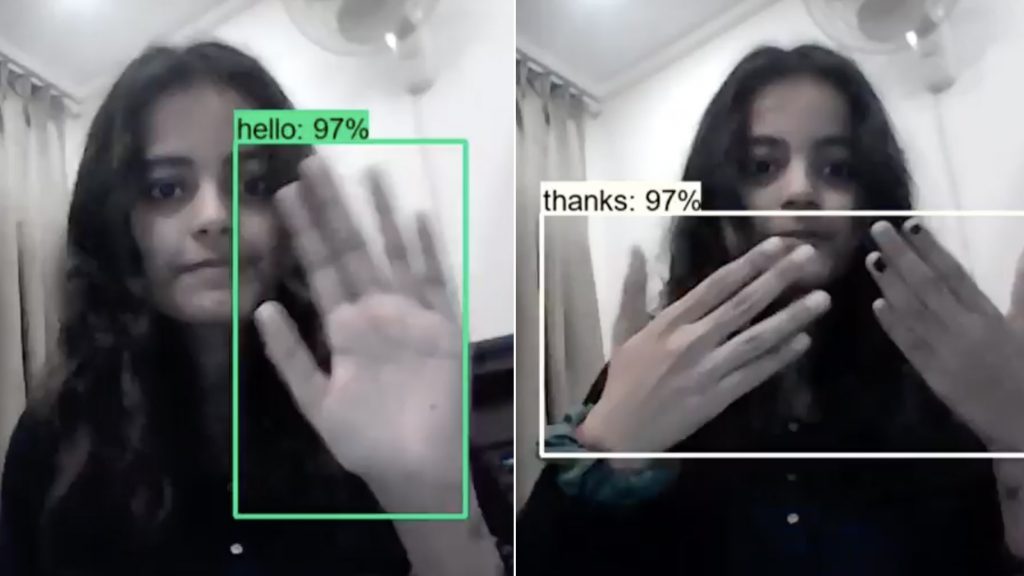

Une élève ingénieur indienne de 20 ans, Priyanjali Gupta, a développé grâce à l’IA un logiciel permettant de traduire, et en temps réel, la langue des signes en mots.

Priyanjali Gupta, étudiante en 3e année au Vellore Institute of Technology dans l’État du Tamil Nadu (Inde), a mis au point un logiciel qui permet, via une webcam et une technologie basée sur l’IA, d’identifier le geste de la langue des signes pour la traduire instantanément en mots. Pour l’instant, ce logiciel innovant ne traduit que la langue des signes américaine (chaque langue signant de façon différente). Disponible en open source, il est très probable que la communauté scientifique s’empare de cette innovation pour la dupliquer, l’adapter à d’autres langues des signes et l’améliorer.

Résoudre les problèmes que rencontre le monde

Priyanjali a partagé la création de son logiciel sur la plateforme LinkedIn, atteignant les plus de 66 000 likes. Elle y annonce : « Je suis autodidacte avec un intérêt marqué pour le développement et la recherche. Je cherche des occasions d’appliquer mes connaissances techniques pour construire des choses afin de résoudre les problèmes actuels auxquels le monde est confronté. » C’est dans la technologie inclusive que l’inventive future ingénieur a commencé à développer ce projet très prometteur.

Communiquer en temps réel

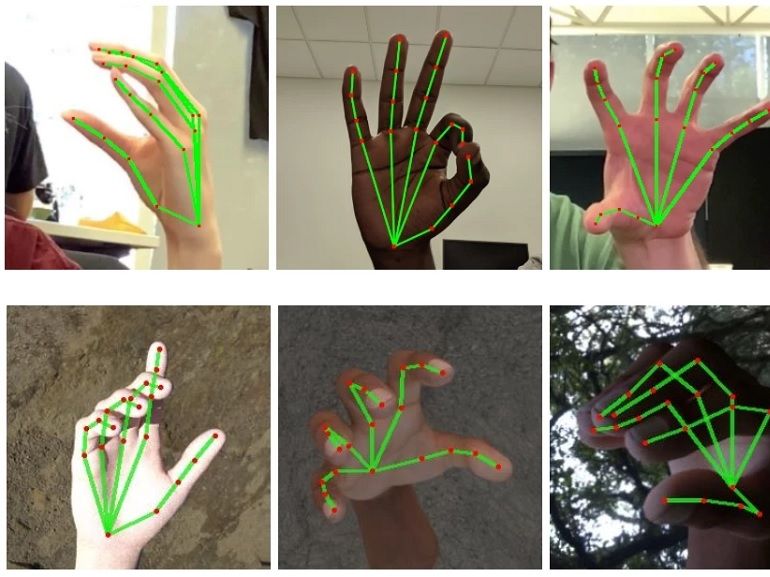

Son système réussit à convertir les gestes de la langue des signes en texte en analysant les mouvements de plusieurs parties du corps, comme les bras et les doigts. La technologie de reconnaissance d’images que l’étudiante a utilisée se base sur la numérisation de la langue des signes de plusieurs personnes. Sur GitHub, la plateforme de développement la plus importante et la plus avancée au monde, sur laquelle le code du logiciel a été posté, le post est devenu viral. Ce logiciel d’IA offrira un moyen dynamique de communiquer avec les personnes sourdes ou malentendantes, en temps réel. Pour commencer, il peut convertir les mouvements de six gestes environ – Oui, Non, S’il vous plaît, Merci, Je t’aime et Bonjour. De nombreuses données complémentaires sont nécessaires pour créer un modèle plus complet, mais en tant que preuve de concept, le système fonctionne. Priyanjali Gupta étudie actuellement l’utilisation de réseaux de mémoire à long terme, un réseau neuronal récurrent artificiel, pour intégrer plusieurs images dans le logiciel.

Une première étape concluante pour combler le fossé de la communication entre personnes sourdes et malentendantes et leurs interlocuteurs et souligner les progrès encore à réaliser en ce qui concerne l’inclusivité dans l’accessibilité technologique à tous.

#Inde, #languedessignes, #inclusivité, #technologie, #IA,